当 AI 比医生更准,你该害怕的不是 AI

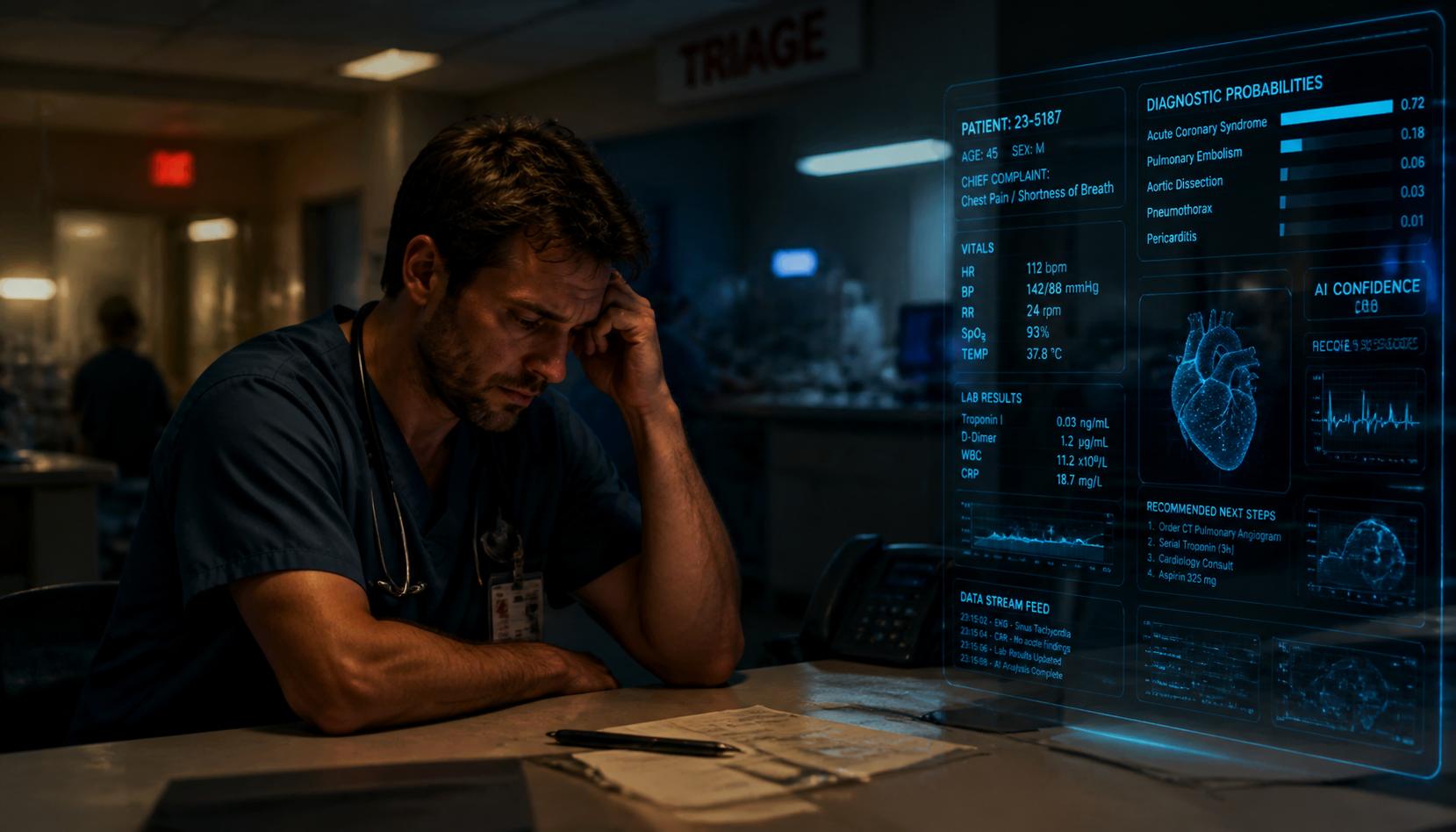

你有没有想过一个细思极恐的问题:你去急诊,分诊台后面坐着的,可能不是人。

这不是科幻。这是哈佛医学院上周发表在《Science》上的一项研究——OpenAI 的 O1 推理模型,在急诊分诊诊断中的准确率达到了 67%,而跟它对阵的两位主治医师,只有 50% 和 55%。

67% vs 50%。

在生死攸关的急诊分诊环节,AI 赢了。

你的第一反应可能是:卧槽,医生要失业了。

错。

真正该让你后背发凉的问题不是「AI 会不会取代医生」,而是——如果你知道了 AI 诊断更准,你还会认真看吗?

咱们来做个对齐。

# 一、67% 到底意味着什么

先说清楚这个数字怎么来的。

哈佛医学院和贝斯以色列医疗中心的研究团队,拿了 76 个真实的急诊病例。这些病人都是波士顿那家医院实实在在来过的——不是模拟的,不是考试的,是真的躺在急诊室里的。

然后,他们给 AI 和两位主治医师看同样的东西:电子健康记录。就是分诊时护士输入的那点东西——生命体征、基本信息、几句话的描述。

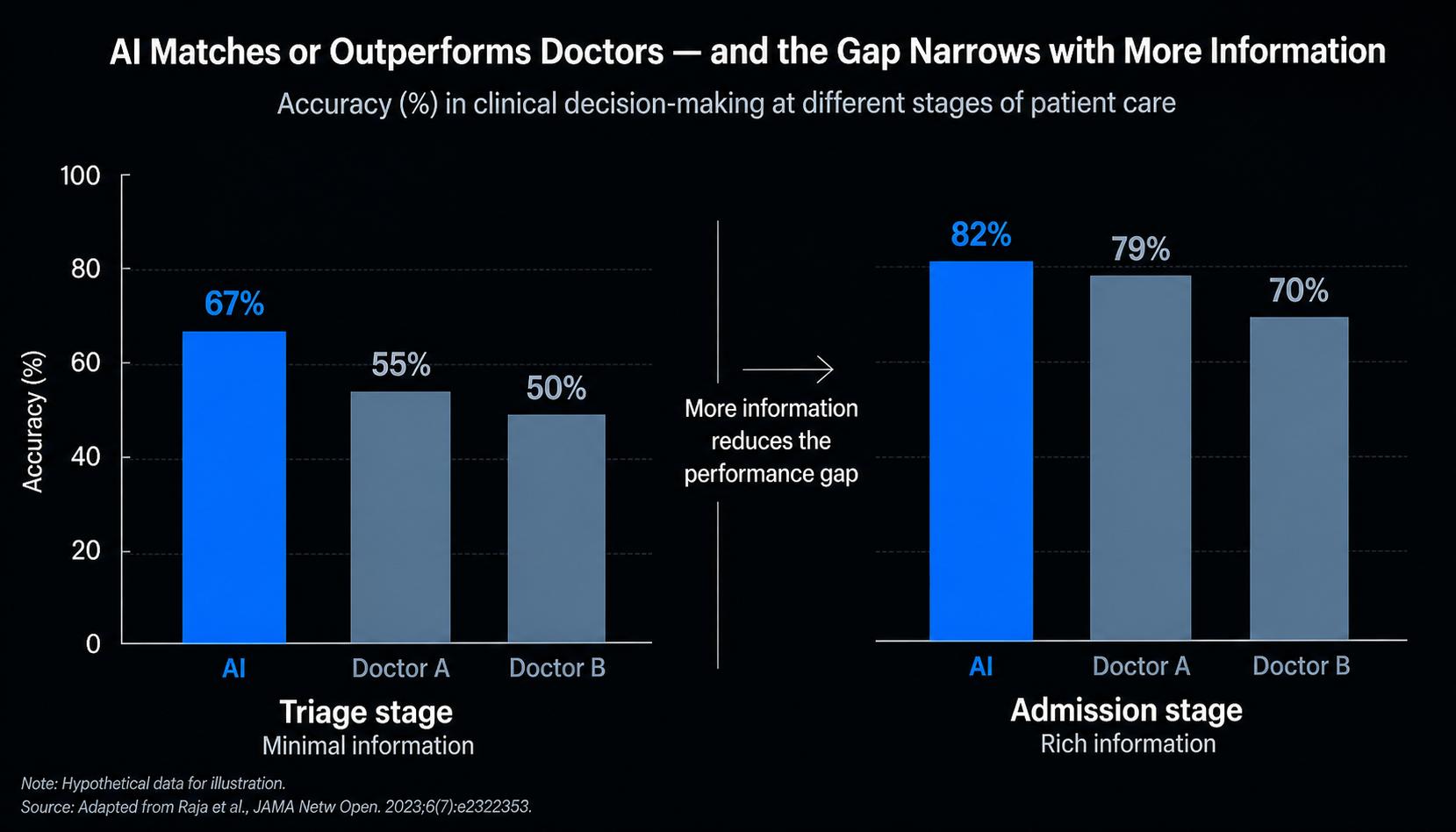

结果:O1 在 67% 的病例中给出了精确或非常接近的诊断,两位医生分别是 55% 和 50%。

更有意思的是,随着信息增多——病人被医生检查过了,各种检查结果回来了——AI 的准确率升到了 82%,医生的准确率也升到了 70%-79%。

但这个差距在统计学上已经不显著了。

这说明什么?

说明 AI 最大的优势,恰恰是在信息最稀薄、时间最紧迫的环节。

而这,正是急诊分诊的本质。

# 二、信息越少,AI 越强

这里有个关键认知。

你可能会觉得,信息越多 AI 越厉害。错了。

AI 的优势不是「信息多的时候算得快」,而是「信息少的时候不容易犯蠢」。

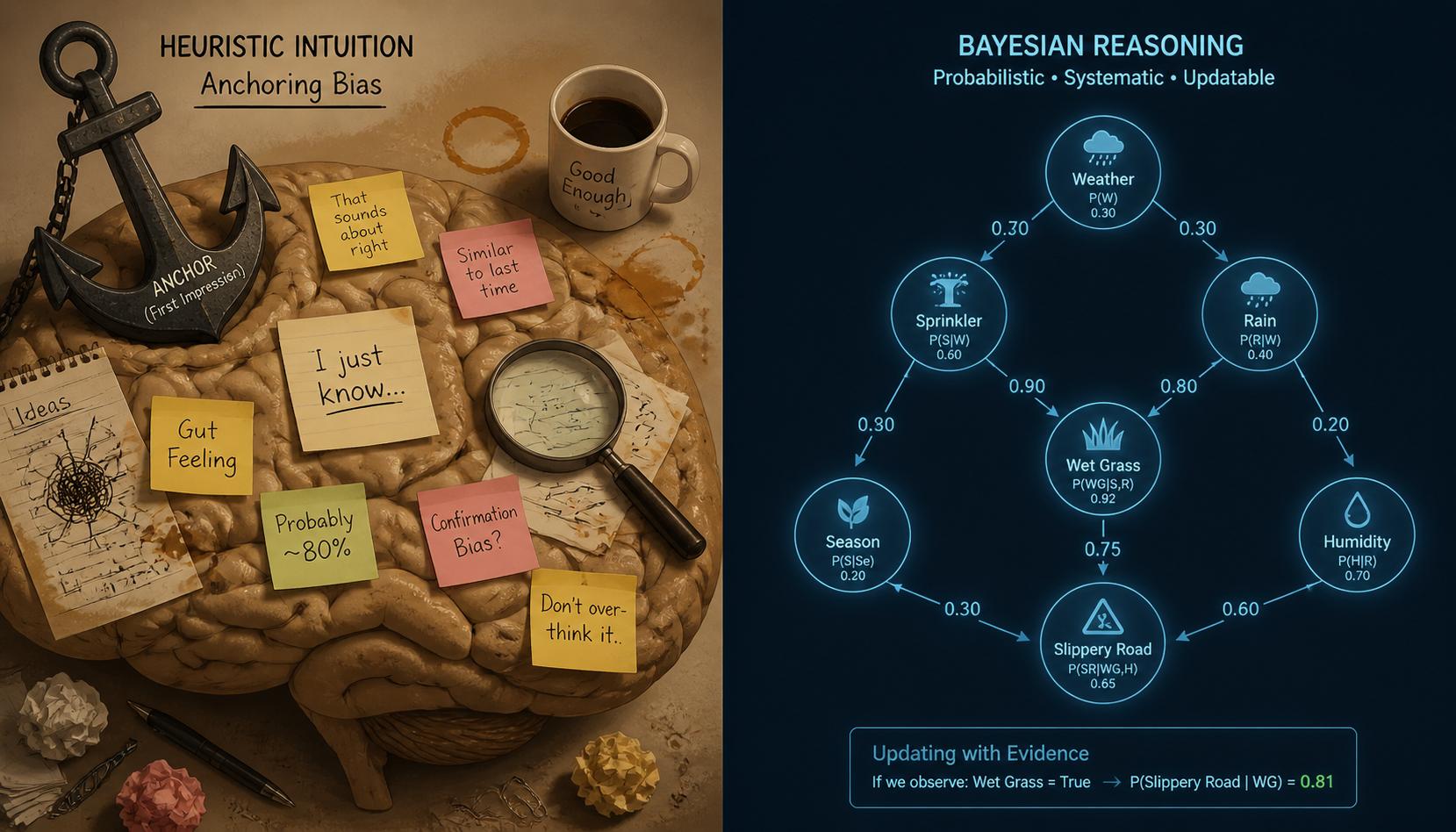

人类医生在信息稀薄的时候会怎样?会靠直觉。而直觉,是进化给你的一套快速启发式算法(Heuristic Algorithm)。在非洲草原上,听到草丛响就觉得是狮子,这套算法能救命。但在急诊室里,这套算法会让你过度依赖经验,产生锚定效应(Anchoring Bias)——第一个跳进脑子的诊断,会像锚一样拽住你的思维。

O1 没有这个问题。

它不靠直觉。它靠的是概率推理——在所有可能的诊断中,找到与已知信息最匹配的那个。当信息极少时,人类直觉的噪声比信号大,而概率推理的噪声始终可控。

说白了,人类在信息不足时加的是「经验滤镜」,AI 加的是「贝叶斯更新(Bayesian Update)」。

哪个更靠谱?在急诊这个场景下,数据已经给出了答案。

# 三、89% vs 34% 才是最炸裂的

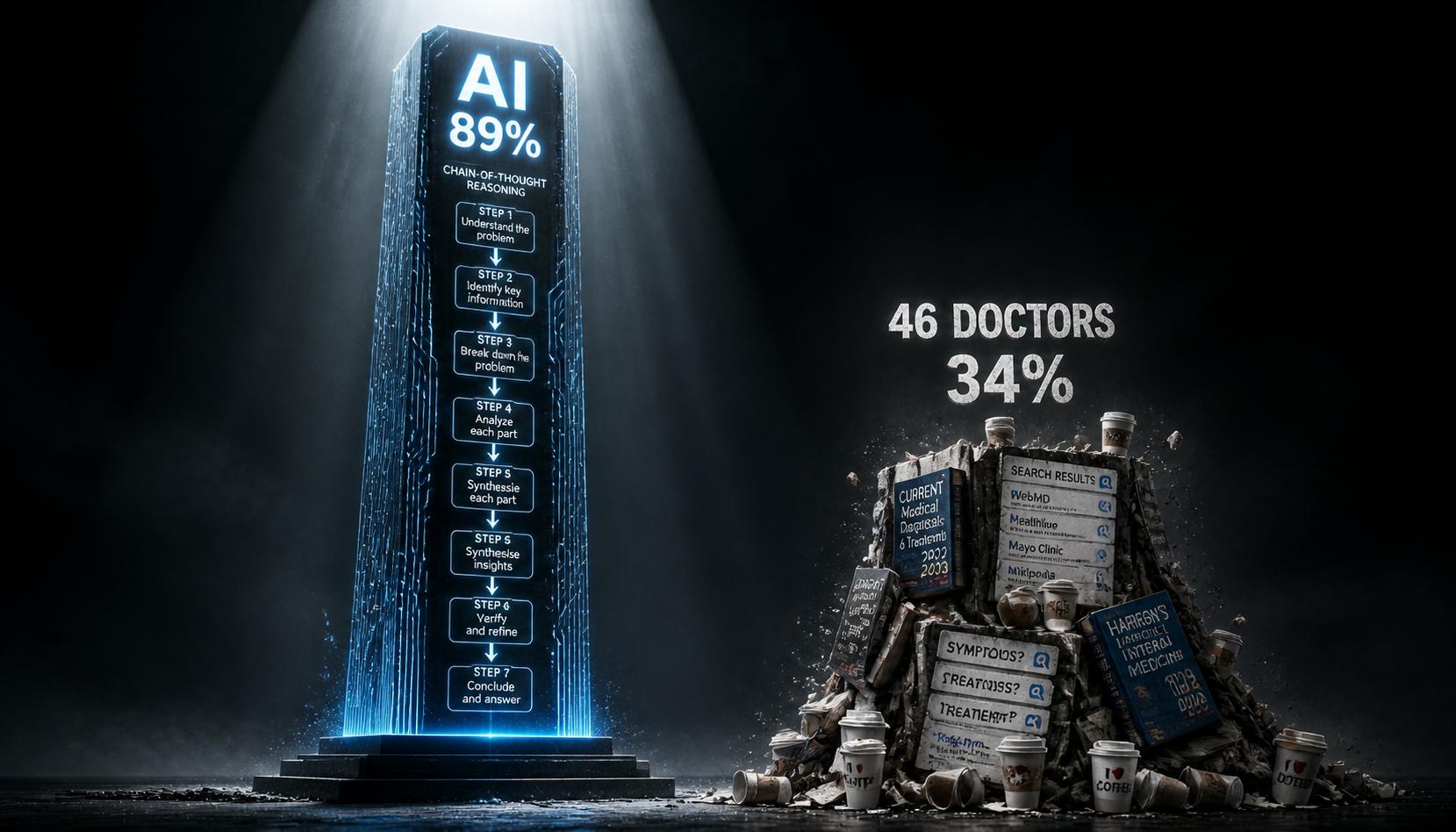

67% vs 50% 已经很惊人了。但研究里还有一组数据,几乎没人讨论。

研究人员让 AI 和 46 位医生分别对 5 个临床病例做长期治疗方案。

AI 得分 89%。

46 位医生,用着搜索引擎、医学数据库、一切他们日常能用的工具,平均得分 34%。

89% vs 34%。

这不是 67% vs 50% 那种「略有优势」。这是碾压。

为什么差距这么大?

因为治疗方案不是诊断。诊断是「这是什么病」,治疗方案是「接下来怎么搞」。前者是分类问题,后者是规划问题——它要求你在多个互相约束的目标之间找到最优路径。

而规划,恰恰是大语言模型通过强化学习训练出来的核心能力。O1 模型名字里的那个「reasoning」,不是白叫的。它在做规划时,会自动进行链式推理(Chain-of-Thought Reasoning),把大目标拆成小步骤,每一步都检查一致性。

人类医生当然也会做规划。但 46 个医生只有 34% 的平均分——这说明在没有 AI 辅助的情况下,人类做复杂规划时的**认知负荷(Cognitive Load)**已经严重超载了。

# 四、真正的问题是认知卸载

说到这里,你可能会想:那就让 AI 来呗,医生配合 AI 不就行了?

这里有个关键认知。

研究团队自己也说了:下一步不是马上把 AI 部署到全国急诊室,而是要做临床试验。

为什么?

因为一旦医生开始依赖 AI,一个心理学机制就会启动——自动化偏见(Automation Bias)。

这是认知心理学中一个已经被反复验证的现象:当人类面对一个自动化系统的建议时,会倾向于接受它,哪怕它是错的。

更致命的是认知卸载(Cognitive Offloading)——当你知道有个 AI 可以帮忙的时候,你自己的思考就会变浅。这不是偷懒,这是大脑的资源分配策略。大脑是能量消耗大户,占体重的 2% 却消耗 20% 的能量。当外部有个更准的工具可以依赖时,大脑会自动降低内部推理的投入。

GPS 就是一个经典案例。研究已经证实,长期依赖 GPS 导航的人,空间认知能力会下降。你的海马体——大脑里负责空间记忆的区域——会因为不被使用而萎缩。

同样的逻辑:如果医生习惯了 AI 给出第一诊断,他们的分诊推理能力会不会退化?

这不是假设。爱尔兰时报去年就报道过,医学教育专家已经在警告:实习医生过度依赖 AI,正在导致临床推理能力的下降。

这才是 67% vs 50% 背后真正的博弈。

# 五、你的算法,你自己写

回到个人层面。

你可能会说:我又不是医生,这跟我有什么关系?

关系大了。

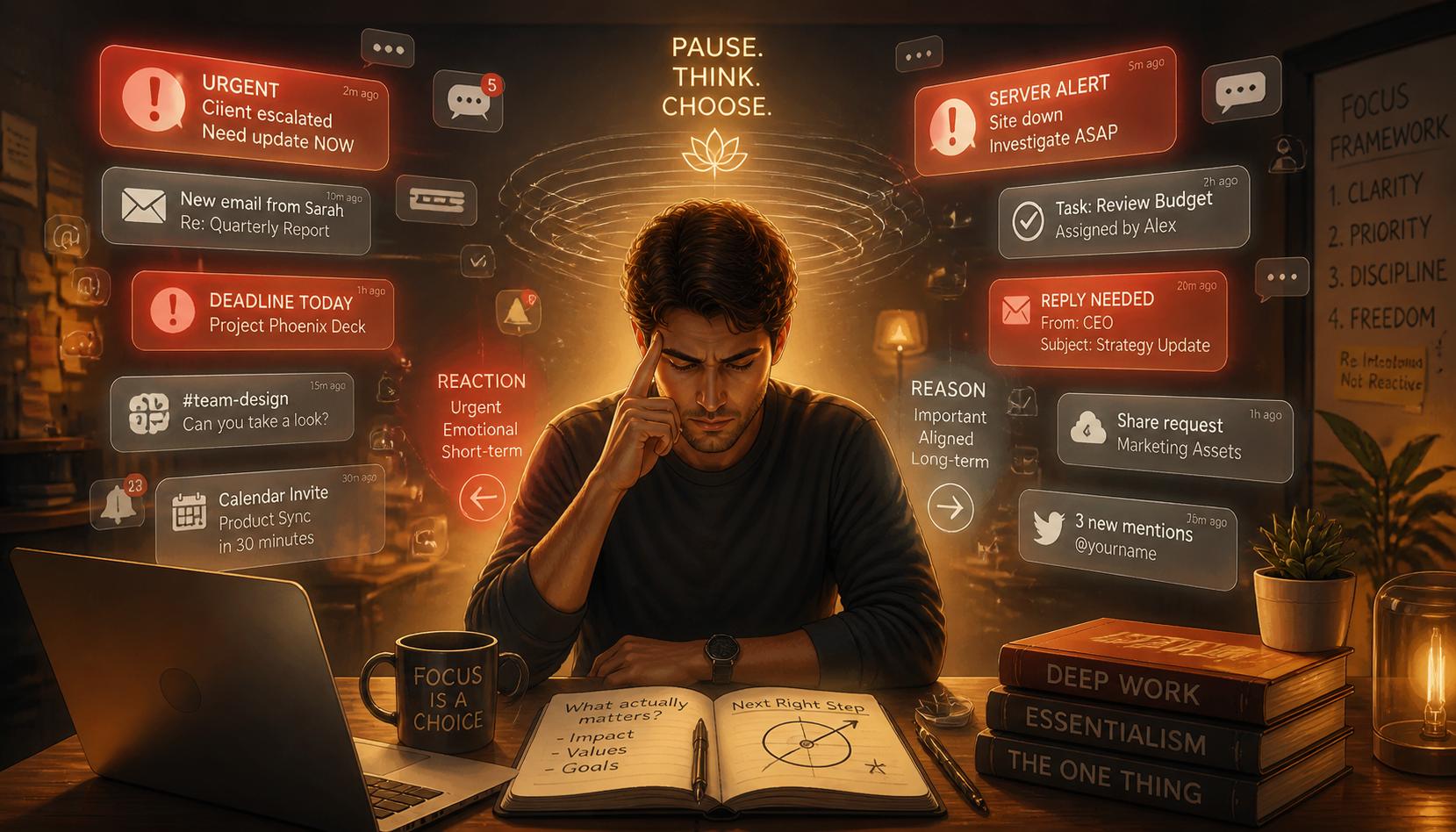

因为你每天都在做「分诊」。不是医学上的分诊,是认知上的。

你打开手机,几十条消息等你处理——哪些重要?哪些可以忽略?你在会议上听到三个方案——哪个最优?你面对一堆待办事项——先做什么?

**这就是你的认知分诊。**信息稀薄、时间紧迫、必须快速判断。

而你大概率在用直觉做分诊——跟急诊室里的医生一样。

直觉不差,但它有系统性的偏差。锚定效应让你被第一印象锁死。可得性偏差(Availability Bias)让你被最近的经历主导。确认偏误(Confirmation Bias)让你只看到支持自己判断的证据。

AI 给我们的启示不是「让 AI 替你思考」,而是——意识到你自己的分诊算法有 bug,然后主动修补。

怎么做?

三个动作。

第一,在你最需要快速判断的时刻,强迫自己停下来问一句:「我现在的判断,是推理出来的还是直觉跳出来的?」这一问,就是**元认知(Metacognition)**的启动——你在监控自己的思维过程。

第二,在信息不足的时候,不要急着下结论。人类的直觉在信息稀薄时噪声最大。先列出 2-3 个可能性,而不是锚定在第一个跳进脑子的答案上。

第三,当你发现一个外部工具(搜索引擎、AI 助手、大 V 的观点)比你自己更准的时候,用它——但不要让它的输出跳过你自己的推理。把它当成输入,不要把它当成结论。

# 六、最后算一笔账

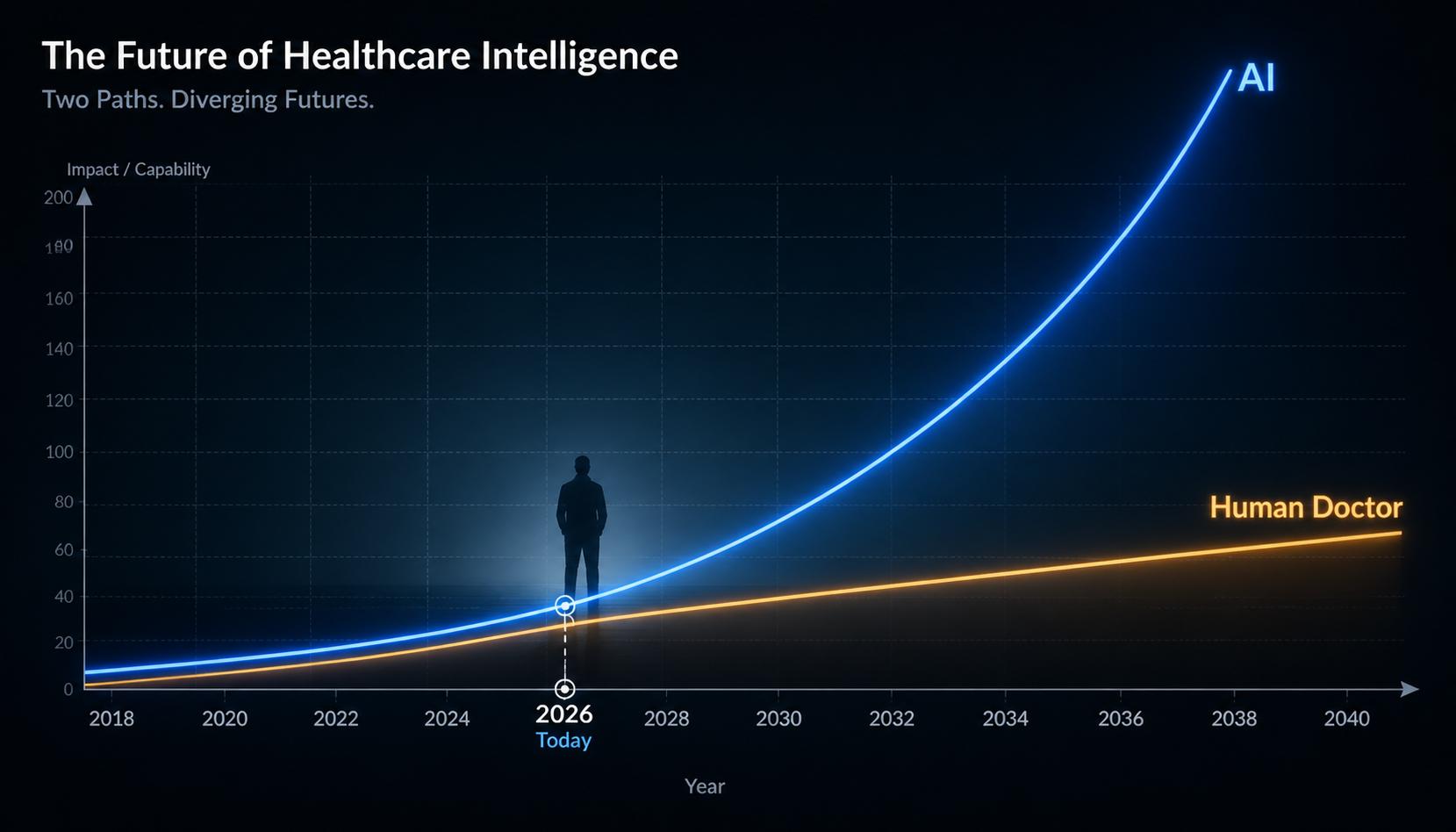

67% vs 50%。这是今天的数字。

但 AI 的进步速度是指数级的,医生的进步速度是线性的。明年这个差距只会更大。

所以问题从来不是 AI 能不能取代医生。问题是你能不能在被 AI 包围的世界里,保持自己思考的能力。

自动化偏见 + 认知卸载,这是一条通向思维退化的滑梯。而元认知,是唯一的安全绳。

说到底,在这个 AI 越来越聪明的时代,最稀缺的不是算力,而是意识到自己正在被算力替代的那个能力。

这才是 67% 这个数字真正告诉你的事。

本站博文如非注明转载则均属作者原创文章,引用或转载无需申请版权或者注明出处,如需联系作者请加微信: geekmaster01